ANTECKNINGAR FRÅN KURSEN ODE Innehåll 1. Introduktion 1 2

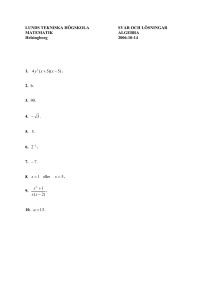

advertisement

ANTECKNINGAR FRÅN KURSEN ODE

LEO LARSSON

Innehåll

1. Introduktion

2. Första ordningens ekvationer

2.1. Separabla ekvationer

2.2. Homogena ekvationer

2.3. Ortogonala kurvfamiljer

2.4. Exakta ekvationer

2.5. Integrerande faktorer

3. Andra ordningens linjära ekvationer

3.1. Existens och entydighet av lösningar

3.2. Hitta nya lösningar från kända lösningar

4. Andra ordningens linjära ekvationer med Konstanta koefficienter

4.1. Homogena ekvationer

4.2. Icke-homogena ekvationer

5. Variation av parametrar

6. System av differentialekvationer

6.1. Linjära system

7. Autonoma system

7.1. Lösningsbanor och fasporträtt

7.2. Kritiska punkter

7.3. Stabilitet

7.4. Linearisering

8. Lyapunovs metod

9. Variationskalkyl

9.1. Eulers ekvation

9.2. Tillämpning av Eulers ekvation

9.3. Fler än en obekant funktion

9.4. Bivillkor med integraler

1

2

2

4

5

6

8

10

10

12

13

13

15

17

18

19

23

23

24

27

28

31

32

34

35

38

39

1. Introduktion

En differentialekvation är en ekvation där den obekanta är en funktion (snarare

än ett tal), och ekvationen involverar denna funktion och dess derivator.

Som även är fallet för numeriska ekvationer, kan en lösning till en differentialekvation inte alltid hittas explicit.

En differentialekvations ordning är den högsta ordningen av derivator som förekommer i ekvationen.

Denna kurs handlar mestadels om ordinära differentialekvationer, vilket betyder att de obekanta funktionerna är funktioner av en variabel (till skillnad från

s.k. partiella differentialekvationer, där funktionerna beror av fler variabler och

derivatorna i ekvationen således är partiella).

1

2

LEO LARSSON

Det är i allmänhet lätt att kontrollera huruvida en given funktion är lösning till

en viss differentialekvation.

Exempel 1. Verifiera att y = Cex

tionen

2 /2

, för varje konstant C, löser differentialekva-

dy

= xy.

dx

Lösning. Med givna funktioner y fås

dy

2x x2 /2

2

=

Ce

= xCex /2 = xy.

dx

2

♦

Det är en annan historia att verkligen hitta lösningen till en given ekvation.

Som med vanliga ekvationer, behöver vi anpassa lösningsmetoden efter ekvationens

utseende. Nedan behandlas några olika klasser av differentialekvationer, och därtill

hörande lämpliga lösningsmetoder.

2. Första ordningens ekvationer

2.1. Separabla ekvationer. Vi börjar med ett exempel.

Exempel 2. Lös ekvationen

dy

= xy.

dx

Lösning. Skriv

1 dy

= x,

y dx

och notera att kedjeregeln ger

1 dy d

y dx dx

Z

1

dy ,

y

ty uttrycket inom parentes i högerledet representerar en funktion vars derivata

m.a.p. y är y1 . Vidare gäller att

d x2

,

x=

dx 2

så den givna ekvationen kan skrivas

Z

d

1

d x2

dy =

.

dx

y

dx 2

Integration m.a.p. x ger nu

log |y| =

x2

+ D,

2

där D är någon konstant, eller

|y| = eD ex

2 /2

.

Sätt C = ±eD . Vi erhåller den allmänna lösningen

y = Cex

2 /2

.

♦

Detta illustrerar en allmän princip beträffande s.k. separabla ekvationer.

ANTECKNINGAR ODE

3

Definition 1. En differentialekvation av första ordningen sägs vara separabel om

den kan skrivas

dy

= f (x)g(y).

dx

Här är f någon funktion som inte beror på y, och g beror inte på x.

För att lösa denna, skriver vi

1 dy

= f (x),

g(y) dx

och noterar att kedjeregeln ger

1 dy

d

=

g(y) dx

dx

Z

1

dy .

g(y)

Integration m.a.p. x ger

Z

1

dy =

g(y)

Z

f (x) dx + C.

Denna metod, kallad variabelseparation, kan minnas genom att ”multiplicera med

dx”:

dy

= f (x) dx.

g(y)

Vi har då samlat y till vänster och x till höger i ekvationen. Vi hakar sedan på

integraltecken (och integrationskonstant):

Z

Z

dy

= f (x) dx + C.

g(y)

Kom dock ihåg att detta bara är en minnesregel, och den fungerar bara för ekvationer av första ordningen.

I princip kan vi alltid lösa separabla ekvationer, även om integrationerna ibland

är svåra att genomföra. Och även om vi kan lösa integralerna, är det inte alltid

möjligt att lösa ut y som en funktion av x. Det senare är dock inget större problem,

då det går utmärkt att ge lösningen implicit. Nästa exempel visar detta.

Exempel 3. Lös ekvationen

dy

x

=− .

dx

y

Lösning. Ekvationen är separabel:

Z

y dy = −x dx

Z

y dy = − x dx + C

y2

x2

=− +C

2

2

x2 + y 2 = r 2 .

(r2 = 2C)

♦

I exemplet ovan anges lösningen som en familj av kurvor (närmare bestämt

familjen av cirklar centrerade i origo). Varje kurva i familjen är en lösning till

ekvationen, även om vi inte anger y explicit som funktion av x. Genom varje

punkt i planet passerar precis en av kurvorna x2 + y 2 = r2 .

4

LEO LARSSON

2.2. Homogena ekvationer. En funktion g(x, y) sägs vara homogen av grad n

om

g(tx, ty) = tn g(x, y)

för alla lämpliga x, y och t.

Exempel 4.

(a) Låt g(x, y) = xp y q . Då gäller att

g(tx, ty) = (tx)p (ty)q = tp+q xp y q = tp+q g(x, y).

g är alltså homogen av grad p + q.

(b) Låt h(x, y) = x00 2 + y 2 . Då är h homogen av grad 2.

(c) Om k(x, y) och l(x, y) är homogena av samma grad, är även k(x, y)+l(x, y)

homogen.

♦

Definition 2. Ekvationen

dy

= g(x, y)

dx

är en homogen differentialekvation om funktionen g är homogen av grad 0.

Nedan presenteras ett trick för att lösa en homogen ekvation.

Exempel 5. Lös ekvationen

dy

3y

=2+ .

dx

x

Lösning. Ekvationen är inte separabel. Däremot är högerledet summan av två

homogena funktioner av grad 0, alltså självt en homogen funktion av grad 0.

Ekvationen är alltså homogen. Tricket är att införa en ny funktion z av x, enligt

y

z=

eller y = xz.

x

Produktregeln för derivering ger att

dy

dz

=z+x .

dx

dx

Vi får ekvationen

z+x

dz

= 2 + 3z

dx

eller

x

dz

= 2(1 + z).

dx

Denna är separabel:

dz

2 dx

=

1+z

x

log |1 + z| = 2 log |x| + C

1 + z = Dx2

y

1 + = Dx2

x

y = Dx3 − x.

(D = ±eC )

byt tillbaka

♦

ANTECKNINGAR ODE

5

Genom bytet y = xz kunde alltså den homogena ekvationen transformeras till en

separabel ekvation. Detta gäller allmänt för homogena ekvationer. Antag nämligen

att g(x, y) är homogen av grad 0. Då gäller att

g(x, y) = t0 g(x, y) = g(tx, ty)

för alla t. I synnerhet kan vi sätta t = x1 . Detta ger

y

g(x, y) = g 1,

.

x

Om nu xy ersätts med z, så att som i ovanstående exempel

dz

z + x dx

, så transformeras ekvationen

dy

dx

transformeras till

dy

= g(x, y)

dx

till

z+x

dz

= g(1, z)

dx

eller

dz

g(1, z) − z

=

,

dx

x

vilket inses vara en separabel ekvation. Denna löses med variabelseparation, varpå

z byts tillbaka mot xy .

2.3. Ortogonala kurvfamiljer. Betrakta kurvfamiljen

(1)

f (x, y) = c.

Den är en lösning till differentialekvationen

(2)

∂f

∂f dy

+

= 0,

∂x ∂y dx

eller

dy

= g(x, y),

dx

där

g(x, y) = −

fx (x, y)

.

fy (x, y)

På vektorform kan vi skriva (2) som

∇f · (1, y 0 ) = 0,

d.v.s. tangentvektorn (1, y 0 ) är vinkelrät mot gradienten ∇f . För den ortogonala

kurvfamiljen måste alltså gälla att (1, y 0 ) är parallell med ∇f , d.v.s.

(1, y 0 ) = k(fx , fy ),

eller

dy

fy

1

=

=− .

dx

fx

g

Det följer att den ortogonala kurvfamiljen är lösningsfamilj till ekvationen

dy

1

=−

.

dx

g(x, y)

6

LEO LARSSON

Exempel 6. Hitta ortogonala kurvfamiljen till

y = cx2 .

(3)

Lösning. Steg 1: Hitta en ekvation på formen

dy

= g(x, y)

dx

för familjen (3). Derivering m.a.p. x ger

dy

= 2cx.

dx

Vi måste eliminera konstanten c, och gör detta genom att kombinera detta med

(3):

1 dy

,

2x dx

y

c = 2,

x

dy

2y

= .

dx

x

c=

I vårt fall gäller alltså

g(x, y) = 2y/x.

Steg 2: Ersätt g(x, y) med −1/g(x, y). Vi erhåller differentialekvationen

dy

x

=− .

dx

2y

Steg 3: Lös den nya ekvationen. I detta fall har vi en separabel ekvation.

2y dy = −x dx

Z

2 y dy = − x dx + C

Z

x2

y = − + c2

2

x2

y2

+

= 1.

2c2 c2

Den ortogonala kurvfamiljen är en familj av ellipser.

2

♦

2.4. Exakta ekvationer. I föregående avsnitt hittade vi en differentialekvation

för familjen

f (x, y) = c

genom att derivera m.a.p. x:

fx + fy

dy

= 0.

dx

Låt oss formellt ”multiplicera med dx”:

fx dx + fy dy = 0.

Givet en funktion f , om de partiella derivatorna fx och fy existerar kan vi göra

följande symboliska definition:

df = fx dx + fy dy.

ANTECKNINGAR ODE

7

Symbolen df kallas differentialen till f , och kan ses som en slags total derivata.

En fördel med detta skrivsätt är symmetrin – det går lika bra att betrakta x som

funktion av y, vilket ibland är mer praktiskt. Betrakta nu uttrycket

(4)

M (x, y) dx + N (x, y) dy = 0.

Med detta menas differentialekvationen

dy

M (x, y)

=−

dx

N (x, y)

eller

dx

N (x, y)

=−

.

dy

M (x, y)

Om vi kan skriva vänsterledet i (4) som differentialen df till någon funktion f (x, y),

har vi ekvationens lösning omedelbart: f (x, y) = c.

Exempel 7. Lös ekvationen

(1 + 2xy) dx + (x2 + 2y) dy = 0.

Lösning. Vi söker en funktion f (x, y) sådan att

∂f

(5)

= 1 + 2xy

∂x

och

∂f

(6)

= x2 + 2y.

∂y

Om (5) ska gälla, måste vi ha

(7)

f (x, y) = x + x2 y + h(y),

där h(y) är någon funktion som inte beror på x (”integrationskonstanten”). Om

dessutom (6) ska gälla, måste vi ha

x2 + h0 (y) = x2 + 2y.

Vi ser att om vi väljer

h(y) = y 2 ,

kommer (7) att ge en lösning. Alltså är familjen

x + x2 y + y 2 = c

en familj av integralkurvor till den givna ekvationen.

♦

Det är dock ingalunda säkert att givet funktionerna M (x, y) och N (x, y) det

finns ett f (x, y) sådant att

fx = M

och fy = N.

Om det finns en sådan funktion f (x, y), kallas ekvationen (4) för en exakt differentialekvation (eftersom högerledet är exakt lika med en differential df ). Det finns

dock ett test som kan utföras på M och N som avgör huruvida en sådan funktion

existerar.

Sats 1. Ekvationen

M (x, y) dx + N (x, y) dy = 0

är exakt om och endast om

∂N

∂M

=

.

∂y

∂x

8

LEO LARSSON

Bevis. Om ekvationen är ekakt, d.v.s. om det finns f sådant att

fx = M

och fy = N,

ger likhet av blandade andraderivator att

My = fxy = fyx = Nx .

Antag att My = Nx . Vi vill visa att ekvationen är exakt, d.v.s. att det finns ett

f (x, y) med rätt egenskaper. f måste ha formen

Z

f (x, y) = N (x, y) dy + h(x),

för något h. Detta h måste uppfylla

Z

∂

N (x, y) dy + h0 (x) = M (x, y),

∂x

eller

Z

∂

0

h (x) = M (x, y) −

N (x, y) dy.

∂x

Högerledet här får alltså inte bero på y; med andra ord, dess derivata m.a.p. y

måste vara noll. Men enligt antagandet My = Nx och likhet mellan blandade

andraderivator följer att

Z

∂

∂

M−

N dy

∂y

∂x

Z

∂2

=My −

N dy

∂y∂x

Z

∂

∂

=Nx −

N dy

∂x ∂y

=Nx − Nx = 0.

Satsen följer.

Exempel 8. I exemplet ovan hade vi M (x, y) = 1 + 2xy och N (x, y) = x2 + 2y.

Alltså

My = 2x = Nx ,

vilket bekräftar att ekvationen är exakt.

♦

2.5. Integrerande faktorer. Vad gör vi om exakthetstestet för ekvationen

(8)

F (x, y) dx + G(x, y) dy = 0

visar att ekvationen inte är exakt? Kanske kan vi transformera ekvationen till en

exakt ekvation – kanske kan vi ”exaktifiera” ekvationen. Om µ(x, y) är en nollskild

funktion, är ekvationen

µ(x, y)F (x, y) dx + µ(x, y)G(x, y) dy = 0

ekvivalent med (8). Det skulle kunna vara så, att denna nya ekvation är exakt

även om inte (8) är det.

Exempel 9. Lös ekvationen

2xy dx + (y 2 − 3x2 ) dy = 0.

Lösning. Här har vi

F (x, y) = 2xy

och G(x, y) = y 2 − 3x2 .

ANTECKNINGAR ODE

9

Alltså

Fy = 2x 6= −6x = Gx .

Ekvationen är inte exakt. Vi söker därför en funktion µ(x, y) sådan att

2xyµ(x, y) dx + (y 2 − 3x2 )µ(x, y) dy = 0

är exakt. Sätt

M = F µ, N = Gµ.

Vi behöver alltså

Fy µ + F µy = Gx µ + Gµx

2xµ + 2xyµy = −6xµ + (y 2 − 3x2 )µx

8xµ + (3x2 − y 2 )µx + 2xyµy = 0.

Problemet med den ordinära differentialekvationen har nu till synes förvärrats till

en partiell differentialekvation. Men antag t.ex. att det finns ett µ som inte beror

av x. Då förenklas ovanstående ekvation för µ markant:

8xµ + 2xyµy = 0

eller

4µ + yµy = 0.

Detta är en separabel ekvation, och en lösning (vi behöver bara en) är

µ(y) =

1

.

y4

Med detta µ får vi ekvationen

2x

dx +

y3

1

3x2

−

y2

y4

dy = 0.

Denna är exakt (kan för säkerhets skull testas med exakthetstestet från föregående

avsnitt). Vi söker nu en funktion f (x, y) med fx = M och fy = N . Det första av

dessa villkor implicerar att f måste ha formen

f (x, y) =

x2

+ h(y)

y3

för något h (oberoende av x). Det andra villkoret ger för sådana f

3x2

1

3x2

0

− 4 + h (y) = 2 − 4 ,

y

y

y

så

1

y

funkar. Alltså har den givna ekvationen den allmänna lösningen

h(y) = −

x2 1

− =C

y2 y

eller

x2 − y 2 = Cy 3 .

♦

Definition 3. En funktion µ som multiplicerad med ekvationen (8) gör denna till

en exakt ekvation kallas för en integrerande faktor till ekvationen.

10

LEO LARSSON

Exempel 10. Integrerande faktorer har som specialfall följande bekanta metod att

lösa första ordningens linjära ekvationer. Vi betraktar ekvationen

(9)

dy

+ g(x)y(x) = h(x).

dx

Vi kan skriva

(g(x)y − h(x)) dx + dy = 0,

d.v.s. F (x, y) = g(x)y − h(x) och G(x, y) = 1. Sätt M = F µ och N = Gµ. Vi har

då

My = Fy µ + F µy = gµ + (gy − h)µy

och

Nx = Gx µ + Gµx = µx .

Det visar sig att det i detta fall alltid finns en integrerande faktor µ som bara

beror på x, d.v.s. termen (gy − h)µy försvinner:

µ0 (x) = g(x)µ(x)

µ0 (x)

= g(x)

µ(x)

d

log µ(x) = g(x)

dx

Z

log µ(x) =

g(x) dx

R

µ(x) = e

g(x) dx

.

Om (9) multipliceras med denna faktor, kan vänsterledet skrivas som en exakt

derivata:

R

R

dy

d R g(x) dx

e g(x) dx

+ g(x)e g(x) dx y(x) =

e

y(x) .

dx

dx

Lösningen blir då

Z R

R

g(x) dx

e

y(x) =

e g(x) dx h(x) dx + C.

♦

3. Andra ordningens linjära ekvationer

3.1. Existens och entydighet av lösningar. Då vi arbetat med första ordningens ekvationer, har den allmänna lösningen i regel innehållit en godtycklig

konstant. Då det är fråga om andra ordningens ekvationer är antalet konstanter

vanligtvis två. Följande sats, vars bevis inte ges här, är en existens- och entydighetssats för andra ordningens linjära differentialekvationer.

Sats 2. Betrakta differentialekvationen

(10)

y 00 (x) + P (x)y 0 (x) + Q(x)y(x) = R(x),

x ∈ [a, b].

Om P , Q och R är kontinuerliga på [a, b], x0 är någon punkt i [a, b] och y0 och y00

är två reella tal, finns precis en funktion y som uppfyller ekvationen (10) och

y(x0 ) = y0 ,

y 0 (x0 ) = y00 .

ANTECKNINGAR ODE

11

Specialfallet

(11)

y 00 + P y 0 + Qy = 0

av (10) kallas en homogen ekvation. Varje linjärkombination av lösningar till (11)

är en lösning till (11), eftersom derivering är en linjär process: om y1 och y2 är

lösningar till (11), och a1 och a2 är konstanter, gäller att

d

d2

(a1 y1 (x) + a2 y2 (x)) + P (x) (a1 y1 (x) + a2 y2 (x))

2

dx

dx

+ Q(x)(a1 y1 (x) + a2 y2 (x))

= a1 (y100 (x) + P (x)y10 (x) + Q(x)y1 (x))

+ a2 (y200 (x) + P (x)y20 (x) + Q(x)y2 (x))

= a1 · 0 + a2 · 0 = 0.

Definition 4. Två funktioner f och g sägs vara linjärt beroende om antingen

f (x) = kg(x) eller g(x) = kf (x) för alla x, för någon konstant k. I annat fall sägs

f och g vara linjärt oberoende.

Mer allmänt sägs den ändliga mängden {f1 , . . . , fm } av funktioner vara linjärt

beroende om det finns konstanter k1 , . . . , km , ej alla noll, sådana att

k1 f1 (x) + . . . + km fm (x) = 0

för alla x. I annat fall är mängden linjärt oberoende.

Exempel 11.

(a) Låt f (x) = 1 + 2x2 och g(x) = 4 + 8x2 . Eftersom då g(x) =

4f (x) för alla x gäller att f och g är linjärt beroende.

(b) Låt f (x) = ex och g(x) = cos x. Om det finns konstanter a och b sådana

att

af (x) + bg(x) = 0

för alla x, så fås i synnerhet att

π

π/2

ae = 0

x=

2

och

a + b = 0 (x = 0),

varur följer att a = b = 0. Alltså är f och g linjärt oberoende.

♦

Definition 5 (Wronskian). Givet två deriverbara funktioner f och g, definierar

vi dess Wronskian eller Wronski-determinant genom

f (x) g(x) = f (x)g 0 (x) − f 0 (x)g(x).

W (x) = 0

f (x) g 0 (x) Sats 3. Antag att y och z är två lösningar till (11), och låt W vara Wronskianen.

Då gäller antingen att W (x) alltid är noll, eller att W (x) aldrig är noll. I första

fallet är y och z linjärt beroende, i det senare fallet är y och z linjärt oberoende.

Sats 4. Om y och z är två linjärt oberoende lösningar till (11), så är ay + bz den

allmänna lösningen.

Sats 5. Om yh är den allmänna lösningen till (11) och yp är vilken lösning som

helst till (10) (en s.k. partikulärlösning), då är yh + yp den allmänna lösningen till

(10).

12

LEO LARSSON

Exempel 12.

(a) Visa att y(x) = e−x och z(x) = e2x är lösningar till ekvationen

y 00 − y 0 − 2y = 0.

Vad är den allmänna lösningen?

(b) Bestäm a och b så att yp (x) = ax+b är en partikulärlösning till y 00 −y 0 −2y =

4x. Vad är den allmänna lösningen?

Lösning. (a) Eftersom y 0 (x) = −e−x och y 00 (x) = e−x gäller att

y 00 (x) − y 0 (x) − 2y(x) = (1 − (−1) − 2)e−x = 0.

Eftersom z 0 (x) = 2e2x och z 00 (x) = 4e2x får vi att

z 00 (x) − z 0 (x) − 2z(x) = (4 − 2 − 2)e2x = 0.

Både y och z är alltså lösningar till ekvationen. Enligt Sats 4 är den allmänna

lösningen

ce−x + de2x ,

förutsatt att y och z är linjärt oberoende. För dessa funktioners Wronskian gäller

W (x) = e−x · 2e2x − (−e−x )e2x = 3ex 6= 0.

Således är y och z linjärt oberoende enligt Sats 3. (b) yp0 = a och yp00 = 0. Alltså

yp00 − yp0 − 2yp = −a − 2ax − 2b = 4x,

så vi måste ha −2a = 4 eller a = −2, och −a − 2b = 2 − 2b = 0, så b = 1. Alltså

yp (x) = −2x + 1. Den allmänna lösningen är, enligt Sats 5

ce−x + de2x − 2x + 1.

♦

3.2. Hitta nya lösningar från kända lösningar. Enligt teorin i föregående

avsnitt, behövs i allmänhet två linjärt oberoende lösningar till (11) för att vi ska

kunna bestämma den allmänna lösningen. Antag att vi redan har en lösning y.

Kan vi använda den för att hitta en andra (linjärt oberoende) lösning z?

Exempel 13. Betrakta ekvationen

(12)

x2 y 00 − 2xy 0 + 2y = 0.

Man kollar lätt att y(x) = x2 löser (12). Vi försöker hitta en till lösning z på

formen

z(x) = v(x)x2 ,

där funktionen v(x) återstår att bestämma. (Notera att om v(x) är icke-konstant,

blir y och v · y linjärt oberoende — kan kollas med Wronskianen.) Vi har

z 0 = v 0 x2 + 2vx,

z 00 = v 00 x2 + 4v 0 x + 2v

x2 z 00 − 2xz 0 + 2z = x2 (v 00 x2 + 4v 0 x + 2v)

− 2x(v 0 x2 + 2vx)

+ 2vx2

= x4 v 00 + (4x3 − 2x3 )v 0 + (2x2 − 4x2 + 2x2 )v

= x3 (xv 00 + 2v 0 ).

Om nu detta z ska vara en lösning, måste vi ha

xv 00 + 2v 0 = 0,

ANTECKNINGAR ODE

13

eller

d

v 00

2

log v 0 = 0 = − .

dx

v

x

Ett sådant v kan hittas genom integrering:

log v 0 = −2 log x

1

v0 = 2

x

1

v=− .

x

Vårt z blir alltså

1

z(x) = v(x)x2 = − x2 = −x.

x

Tack vare homogeniteten är vi fria att multiplicera denna lösning med valfri konstant, och vi väljer i detta fall −1. x2 och x är linjärt oberoende, så den allmänna

lösningen till (12) är

yg (x) = ax2 + bx.

♦

Denna metod funkar i allmänhet. Det är fullt möjligt att härleda en formel för

en andra lösning z om en lösning y är känd. Vi avstår dock från det här.

4. Andra ordningens linjära ekvationer med Konstanta

koefficienter

4.1. Homogena ekvationer. Vi betraktar specialfallet

y 00 + py 0 + qy = 0

(13)

av en andra ordningens linjär, homogen ekvation, där p och q nu är konstanter.

Uppdraget är att hitta två linjärt oberoende lösningar till (13), och det är vettigt

att leta lösningar på formen

y(x) = emx .

Om detta y deriveras och sätts in i (13) erhålls

(m2 + pm + q)emx = 0,

och för att detta ska gälla för alla x måste vi ha

m2 + pm + q = 0.

(14)

Denna andragradsekvation kallas karakteristisk ekvation till (13). Det finns tre

väsentligt skilda fall för lösningar till (14).

(1) Olika reella rötter m1 och m2 . Genom att studera en Wronski-determinant

inses att em1 x och em2 x är linjärt oberoende. Den allmänna lösningen är

alltså

a1 em1 x + a2 em2 x .

(2) Olika icke-reella rötter m1 = a+ib och m2 = a−ib. Rötterna till (14) måste

ha denna form (med a och b reella), eftersom koefficienterna är reella. Enligt

Eulers formel har vi

em1 x = eax (cos bx + i sin bx).

Sätt

R(x) = eax cos x och I(x) = eax sin bx.

14

LEO LARSSON

Med hjälp av vetskapen att

p

1p

a=−

och b =

4q − p2

2

2

kan vi visa att både R och I löser ekvationen (13). Det gäller dessutom för

Wronski-determinanten av R och I att

W (x) = be2ax ,

och eftersom b antas vara nollskilt innebär detta att R och I är linjärt

oberoende. Den allmänna lösningen blir alltså

eax (c cos bx + d sin bx).

(3) En dubbelrot m. En lösning är naturligtvis

y(x) = emx .

Vi använder tidigare illustrerad metod för att hitta en andra lösning; sätt

z(x) = v(x)emx . Vi söker bestämma funktionen v så att detta z blir en

andra lösning. Vi har

z 0 = (v 0 + mv)emx

z 00 = (v 00 + 2mv 0 + m2 v)emx ,

som insatt i ekvationen ger (notera att m = − p2 )

0 = (v 00 + 2mv 0 + m2 v)emx

+ p(v 0 + mv)emx

+ qvemx

= [v 00 + (2m + p)v 0 + (m2 + pm + q)v]emx = v 00 emx .

Vi måste alltså ha v 00 = 0, och en icke-konstant sådan funktion är v(x) =

x. En andra linjärt oberoende lösning är alltså xemx , så den allmänna

lösningen blir

(c + dx)emx .

Exempel 14. Lös differentialekvationerna

(a) y 00 − 7y 0 + 10y = 0,

(b) y 00 + 2y 0 + 2y = 0 och

(c) y 00 + 6y 0 + 9.

Lösning. (a) Karakteristiska ekvationen är

m2 − 7m + 10 = 0,

och lösningarna till denna är

m1 = 2 och m2 = 5,

d.v.s. två olika reella rötter. Allmänna lösningen blir således

y(x) = c1 e2x + c2 e5x .

(b) Här är karakteristiska ekvationen m2 + 2m + 2 = 0, som har lösningarna

m = −1 ± i.

Enligt resonemanget med real- och imaginärdel ovan blir den allmänna lösningen

y(x) = (c1 cos x + c2 sin x)e−x .

ANTECKNINGAR ODE

15

(c) Den karakteristiska ekvationen m2 + 6m + 9 = 0 har dubbelroten m = 3, så

allmänna lösningen är

y(x) = (c1 + c2 x)e3x .

♦

4.2. Icke-homogena ekvationer. Nu antar vi inte längre att högerledet är noll,

utan betraktar ekvationen

y 00 + py 0 + qy = R(x),

där R(x) är någon funktion. Eftersom vi kan hitta den allmänna lösningen till

motsvarande homogena ekvation

y 00 + py 0 + qy = 0,

gäller det enligt en tidigare presenterad sats att hitta en lösning, en s.k. partikulärlösning, till den icke-homogena ekvationen. Oftast får man försöka sig på en

kvalificerad gissning till hur en partikulärlösning kan se ut.

4.2.1. Exponentialfunktioner.

Exempel 15. Betrakta ekvationen

y 00 + 4y 0 − 5y = 3e2x .

Motsvarande homogena ekvation har den allmänna lösningen

y(x) = c1 ex + c2 e−5x .

Funktionerna

y = Ae2x

kandiderar till rollen som partikulärlösning, och vi söker bestämma konstanten A:

y 0 = 2Ae2x ,

Vi ser att A =

3

7

y 00 = 4Ae2x .

0 = (4A + 4 · 2A − 5 · A)e2x = 7Ae2x .

funkar bra. Allmänna lösningen är alltså

3

y(x) = c1 ex + c2 e5x + e2x .

7

Exempel 16. Betrakta nu istället den något modifierade ekvationen

y 00 + 4y 0 − 5y = 3ex .

Den ”kvalificerade gissningen” y = Aex fungerar inte längre, ty denna ansats leder

till ekvationen

0 · A = 3,

vilket är omöjligt. Detta beror på att ex också löser den homogena ekvationen, så

den funktionen är redan ”förbrukad”. Istället försöker vi, inspirerade av fallet med

en dubbelrot till karakteristiska ekvationen, med

y = Axex .

Vi får då efter derivering och insättning

6Aex = 3ex ,

och vi ser att valet måste bli A = 21 . Allmän lösning blir

1

y(x) = c1 ex + c2 e5x + xex .

2

16

LEO LARSSON

Exempel 17. Om vi nu istället har ekvationen

y 00 − 4y 0 + 4y = e2x ,

vars homogena motsvarighets karakteristiska ekvation har dubbelroten m = 2,

räcker inte ens y = Axe2x som ansats till partikulärlösning, utan vi måste gå

ytterligare ett steg och dra till med

y = Ax2 e2x .

4.2.2. Trigonometriska funktioner. Om högerledet är cos ax eller sin ax eller en

linjärkombination av dessa, ansätter vi partikulärlösningen

A sin ax + B cos ax.

Exempel 18. Lös begynnelsevärdesproblemet

00

y − 4y 0 + 3y = sin 2x + 8 cos 2x,

y(0) = 0, y 0 (0) = 1.

Lösning. Homogena motsvarigheten till ekvationen har karakteristisk ekvation

m2 − 4m + 3 = 0,

vars lösningar är

m1 = 1, m2 = 3.

Olika reella rötter alltså. Detta ger de linjärt oberoende lösningarna ex och e3x till

den homogena ekvationen. Som partikulärlösning ansätter vi

y(x) = A sin 2x + B cos 2x,

y 0 (x) = −2B sin 2x + 2A cos 2x,

y 00 (x) = −4A sin 2x − 4B cos 2x,

vilket insatt i ekvationen ger

(−4A − 4(−2B) + 3A) sin 2x + (−4B − 4 · 2A + 3B) cos 2x = sin 2x + 8 cos 2x.

Identifikation av koefficienterna för sin 2x respektive cos 2x ger ekvationssystemet

−A +8B = 1,

−8A −B = 8,

som har lösningen A = −1, B = 0. Den allmänna lösningen till ekvationen är

således

y(x) = c1 ex + c2 e3x − sin 2x.

Vi söker bestämma konstanterna c1 och c2 så att begynnelsevillkoren uppfylls:

y(0) = 0 ⇔ c1 + c2 = 0,

y 0 (0) = −1 ⇔ c1 + c2 − 2 = −1.

Det följer att

c1 = −

3

2

3

och c2 = .

2

Den entydiga lösningen blir

3

3

y(x) = e3x − ex − sin 2x.

2

2

även i fallet med trigonometriska funktioner i högerledet kan det inträffa att

den ”uppenbara” ansatsen till partikulärlösning redan löser den homogena ekvationen, i vart fall man istället provar att multiplicera den till en början tilltänkta

partikulärlösningen med x.

ANTECKNINGAR ODE

17

4.2.3. Polynom. Om R(x) är ett polynom av grad n, kan vi som partikulärlösning

ansätta ett polynom av grad n, n + 1 eller n + 2.

5. Variation av parametrar

Vi illustrerar en metod att hitta partikulärlösningar till ekvationer på formen

y 00 + P y 0 + Qy = R,

där P och Q inte nödvändigtvis är konstanter, och där den allmänna lösningen till

ekvationen

y 00 + P y 0 + Qy = 0

antas vara känd.

Exempel 19. Hitta en partikulärlösning till ekvationen

x2 y 00 − 2xy 0 + 2y = x3 cos x.

Lösning. Den allmänna lösningen till motsvarande homogena ekvation hittade vi

i Exempel 13, och den är

y = c1 x + c2 x2 .

Vi vill variera parametrarna c1 och c2 , d.v.s. ersätta konstanterna med funktioner,

och på så sätt försöka hitta en partikulärlösning. Ansatsen är alltså

y = v1 x + v2 x2 ,

där vi vill bestämma funktionerna v1 och v2 så att detta y löser ekvationen. Vi

har

y 0 = v10 x + v1 + v20 x2 + 2v2 x.

Tricket är att kräva att termerna som involverar derivator av de okända funktionerna v1 och v2 försvinner — vi kräver med andra ord

xv10 + x2 v20 = 0.

Andraderivatan för den ansatta partikulärlösningen blir då lite lättare att hantera:

y 00 = v10 + 2xv20 + 2v2 .

Insatt i ekvationen får vi

x3 cos x = x2 (v10 + 2xv20 + 2v2 ) − 2x(v1 + 2xv2 ) + 2(xv1 + x2 v2 )

= x2 v10 + 2x3 v20 + (−2x + 2x)v1 + (2x2 − 4x2 + 2x2 )v2

= x2 v10 + 2x3 v20 .

Vi har alltså två ekvationer med obekanta v10 och v20 , nämligen1

v10 + xv20 = 0,

v10 + 2xv20 = x cos x.

Subtraktion av den första från den andra av dessa ger

xv20 = x cos x

eller

v2 = sin x,

1Notera

att detta är ett linjärt ekvationssystem i v10 och v20 . Om vi förlänger första ekvationen med x blir dessutom koefficientmatrisens determinant precis lika med Wronskianen för

lösningarna x och x2 till den homogena ekvationen. Detta är ingen slump, utan lösningarna till

homogena ekvationen dyker upp här i allmänhet.

18

LEO LARSSON

så

v10 = −x cos x

eller

v1 = −x sin x − cos x.

En partikulärlösning är således

y(x) = xv1 (x) + x2 v2 (x)

= −x2 sin x − x cos x + x2 sin x

= −x cos x.

♦

Det är fullt möjligt att härleda formler för v1 och v2 i det allmänna fallet, men

detta avstår vi från här av ett antal skäl.

6. System av differentialekvationer

Betrakta den linjära differentialekvationen

(15)

x00 (t) + P (t)x0 (t) + Q(t)x(t) = R(t).

Inför en ny funktion y genom att låta

y(t) = x0 (t).

Enligt (15) har vi att

y 0 (t) = x00 (t)

= −Q(t)x(t) − P (t)x0 (t) + R(t)

= −Q(t)x(t) − P (t)y(t) + R(t).

Vi har alltså följande system av differentialekvationer.

0

x (t) = y(t),

(16)

y 0 (t) = −Q(t)x(t) − P (t)y(t) + R(t).

Om x är en lösning till (15), och om y definieras som ovan, så är (x, y) en lösning

till systemet (16). Omvänt, om (x, y) är ett par av funktioner som uppfyller båda

ekvationerna i (16), så är x en lösning till (15).

Mer allmänt, betrakta ekvationen

(17)

x(n) (t) = f (t, x, . . . , x(n−1) ).

Låt

x1 = x,

x2 = x0 ,

x3 = x02 = x00 ,

..

.

xn = x(n−1) .

(17) kan då skrivas som systemet

0

x = x2 ,

01

xx = x3 ,

..

0 .

xn = f (t, x1 , . . . , nn−1 ).

ANTECKNINGAR ODE

19

Exempel 20. Betrakta ekvationen

x00 (t) + 4x2 (t) = sin t,

(18)

och sätt y(t) = x0 (t). Vi har alltså

y 0 (t) = sin t − 4x2 (t),

så (18) kan skrivas

x0 (t) = y(t),

y 0 (t) = sin t − 4x2 (t).

♦

6.1. Linjära system. Ett system av två linjära ekvationer i två obekanta har

formen

0

x = a1 x + b1 y + f1 ,

(19)

y 0 = a2 x + b2 y + f2 .

Koefficienterna aj , bj och fj antas här vara kontinuerliga funktioner av t. Vi kallar

systemet (19) för homogent om f1 = f2 = 0, annars icke-homogent.

I analogi med andra ordningens linära har vi följande teoretiska maskineri.

Definition 6 (Wronskian). Om (x1 , y1 ) och (x2 , y2 ) är lösningar till det homogena

systemet

0

x = a1 x + b1 y,

(20)

y 0 = a2 x + b2 y,

definierar vi Wronskianen eller Wronski-determinanten av lösningarna enligt

W (t) = x1 (t)y2 (t) − x2 (t)y1 (t).

Sats 6. Antag att (x1 , y1 ) och (x2 , y2 ) är lösningar till det homogena systemet

(20), och låt W vara Wronskianen. Då gäller antingen att W (t) alltid är noll, i

vart fall de båda lösningarna är linjärt beroende, eller att W (t) aldrig är noll, i

vart fall lösningarna är linjärt oberoende.

Sats 7. Om (x1 , y1 ) och (x2 , y2 ) är linjärt oberoende lösningar till (20), så är

c1 (x1 , y1 ) + c2 (x2 , y2 )

den allmänna lösningen.

Sats 8. Om (xh , yh ) är den allmänna lösningen till (20) och (xp , yp ) är vilken

lösning som helst till (19), så ges allmänna lösningen till (19) av

(xh , yh ) + (xp , yp ).

Exempel 21. Vi betraktar systemet

0

x (t) = 3x(t) + 4y(t),

(21)

y 0 (t) = x(t) + 3y(t).

Detta system är homogent. Med beteckningar som ovan har vi

a1 = 3, b1 = 4, a2 = 1, b2 = 3.

Betrakta först paret (x1 , y1 ) av funktioner, definierade genom

x1 (t) = −2et ,

y1 (t) = et .

Dessa båda funktioner är sina egna derivator. Vi har därmed

3x1 (t) + 4y1 (t) = −6et + 4et = −2et = x01 (t)

20

LEO LARSSON

och

x1 (t) + 3y1 (t) = −2et + 3et = et = y10 (t).

Alltså är (x1 , y1 ) en lösning till (21). Definiera nu (x2 , y2 ) genom

x2 (t) = 2e5t ,

y2 (t) = e5t .

Man visar enkelt att även (x2 , y2 ) är en lösning till (21). Wronskianen för dessa

lösningar ges av

W (t) = −4e6t 6= 0,

så de är linjärt oberoende. Varje lösning kan alltså skrivas på formen

x(t) = −2c1 et + 2c2 e5t ,

y(t) = c1 et + c2 e5t .

♦

Exempel 22. Låt

A=

3 4

1 3

.

För att hitta egenvärdena till A, löser vi karakteristiska ekvationen

det(A − λI) = 0,

eller

λ2 − 6λ + 5 = 0.

Lösningarna är

λ1 = 1,

λ2 = 5.

För att hitta egenvektorerna tillhörande egenvärdet λ1 löser vi systemet

x

(A − λ1 I)

= 0,

y

eller, skrivet i matrisform

2 4 0

1 2 0

.

Lösningarna är

x

y

= c1

−2

1

.

På samma sätt fås att egenvektorerna tillhörande egenvärdet λ2 är

x

2

.

= c2

y

1

Om vi jämför siffrorna i detta exempel med siffrorna i linjära systemet ovan, ser

vi att allmänna lösningen till (21) är

x(t)

= c1 eλ1 t v1 + c2 eλ2 t v2 ,

y(t)

där λj och vj är egenvärden resp. egenvektorer till koefficientmatrisen till systemet

(21). är detta en slump?

♦

ANTECKNINGAR ODE

21

Exempel 23. Ett sätt att lösa systemet (21) är att derivera den andra ekvationen

och ersätta x0 med högerledet i den första. Vi får

y 00 = x0 + 3y 0

= 3x + 4y + 3y 0 .

Om vi löser ut x ur den andra av ekvationerna (21) och sätter in ovan, får vi

ekvationen

y 00 = 3(y 0 − 3y) + 4y + 3y 0

eller

y 00 − 6y 0 + 9y = 0.

Karakteristiska ekvationen för denna är

m2 − 6m + 5 = 0,

och har lösningarna

m1 = 1 och m2 = 5.

Tillhörande lösningar blir

y1 (t) = et

och y2 (t) = e5t .

Motsvarande funktioner xj fås ur den andra ekvationen i systemet (21):

xj (t) = yj0 (t) − 3yj (t).

Alltså

x1 (t) = −2et och x2 (t) = 2e5t .

Vi har därmed lösningarna

x1 (t)

−2et

=

y1 (t)

et

och

5t 2e

x2 (t)

.

=

e5t

y2 (t)

Notera att karakteristiska ekvationen för andra ordningens ekvationen ovan är

samma som för koefficientmatrisen A i föregående exempel.

♦

Exempel 24. En annan metod att lösa (21) är att leta efter lösningar på formen

x(t)

Aemt

,

=

y(t)

Bemt

d.v.s. vi försöker hitta både x och y samtidigt. Ansatsen ger att

mAemt = 3Aemt + 4Bemt ,

mBemt = Aemt + 3Bemt

för alla t. Division med emt och lite omflyttning ger det linjära ekvationssystemet

(3 − m)A + 4B = 0,

A + (3 − m)B = 0

med A och B som obekanta. A = B = 0 är alltid en lösning, men detta ger

x(t) = y(t) = 0, som inte är särskilt intressant. För att icke-triviala lösningar ska

finnas, krävs att

(3 − m)(3 − m) − 4 = 0,

eller

m2 − 6m + 5 = 0.

22

LEO LARSSON

Detta är,återigen, samma ekvation som tidigare. För var och en av rötterna m1 = 1

och m2 = 5 kan vi hitta icke-triviala lösningar (A, B), och därmed även lösningar

till systemet (21).

♦

I nedanstående två exempel används ytterligare en metod, som beskrivs i separat häfte.

Exempel 25. Lös det linjära systemet

x0 = 3x + y,

y 0 = −x + y.

Lösning. Låt

3 1

A=

.

−1 1

A har ett dubbelt egenvärde λ = 2. Enligt analytiska metoden har vi

eAt = b0 I + b1 A,

där b0 och b1 uppfyller

b0 + 2b1 = e2t

och

b1 = te2t .

Vi får

b0 = e2t − 2te2t ,

så

At

e

2t

2t

1 0

0 1

2t

= (e − 2te )

+ te

(1 + t)e2t

te2t

=

,

−te2t

(1 − t)e2t

3 1

−1 1

så lösningen ges av

x(t)

y(t)

At

c1

c2

=e

(c1 (1 + t) + c2 t)e2t

=

.

(−c1 t + c2 (1 − t))e2t

Exempel 26. Lös begynnelsevärdesproblemet

x0 = 3x − 4y,

y 0 = 2x − y,

x(0) = 2,

y(0) = 1.

Lösning. Denna gång har matrisen

A=

3 −4

2 −1

egenvärdena

λ = 1 ± 2i,

så

eAt = b0 I + b1 A,

där b0 och b1 bestäms ur systemet

b0 + (1 + 2i)b1 = e(1+2i)t ,

b0 + (1 − 2i)b1 = e(1−2i)t .

ANTECKNINGAR ODE

23

Notera dock att dessa båda ekvationer kan delas upp i real- och imaginärdel (under

förutsättning att b0 och b1 antas vara reella), vilket ger följande ekvivalenta system.

b0 + b1 = et cos 2t,

2b1 = et sin 2t.

Vi får

1

b1 = et sin 2t

2

1

t

b0 = e cos 2t − sin 2t .

2

och

eAt kan nu beräknas:

eAt = b0 I + b1 A

1

1 t

1 0

3 −4

t

= e cos 2t − sin 2t

+ e sin 2t

0 1

2 −1

2

2

t

e (cos 2t + sin 2t)

−2et sin 2t

.

=

2t sin 2t

et (cos 2t − sin 2t)

Lösningen blir

x(t)

y(t)

At

=e

=

2

1

et cos 2t

t

e (2 cos 2t − sin 2t)

.

7. Autonoma system

Vi betraktar systemet

(22)

x0 = F (x, y),

y 0 = G(x, y).

x och y är här funktioner av t, och derivatorna i vänsterleden är derivator m.a.p.

t. Funktionerna F resp. G i högerleden antas vara kontinuerliga funktioner med

kontinuerliga första ordningens partiella derivator m.a.p. x och y (för enkelhets

skull kan vi anta att detta gäller i hela planet). Däremot beror F och G inte på

variabeln t. Denna avsaknad av t-beroende gör systemet (22) till vad vi kallar ett

autonomt system av differentialekvationer.

7.1. Lösningsbanor och fasporträtt. Antag att [x(t), y(t)] är en lösning till det

autonoma systemet (22). Denna lösning kan (med fördel) betraktas som en kurva

i planet, parametriserad av t. Då t varierar, ritar [x(t), y(t)] ut en riktad kurva,

en s.k. lösningsbana till systemet. Med ”riktad” menas att punkterna på kurvan

ritas ut i en viss riktning då t växer. I vissa fall är dock lösningen (x, y) konstant;

i detta fall består lösningsbanan bara av en enda punkt.

En övergripande bild av lösningsbanorna till systemet (22) kallas för ett fasporträtt.

I allmänhet svarar varje bana i fasporträttet mot flera lösningar.

I princip kan lösningsbanorna till (22) räknas fram genom att lösa ekvationen

dy

G(x, y)

=

dx

F (x, y)

av första ordningen.

24

LEO LARSSON

Exempel 27. Bestäm lösningsbanorna till det autonoma systemet

0

x = 3xy 3 ,

y 0 = −2x2 y.

Lösning. Vi vill lösa ekvationen

dy

G(x, y)

=

¸

dx

F (x, y)

där F (x, y) = −2x2 y och G(x, y) = 3xy 3 . Vi får, efter förenkling, den separabla

ekvationen

dy

2x

= − 2,

dx

3y

som har lösningen

x2 + y 3 = c.

♦

7.2. Kritiska punkter. Om P0 = (x0 , y0 ) är en punkt i planet där både F och

G är noll, d.v.s. om

F (x0 , y0 ) = 0 och G(x0 , y0 ) = 0,

så säger vi att P0 är en kritisk punkt till systemet (22). Kritiska punkter svarar

mot konstanta lösningar. Vi ska studera några olika typer av kritiska punkter.

7.2.1. Noder. Betrakta systemet

x0 = −2x + y,

y 0 = x − 2y.

Uppenbarligen är O = (0, 0) enda kritiska punkten. Lösningsbanorna kan bestämmas

genom att den homogena ekvationen

dy

x − 2y

=

dx

−2x + y

löses. Vi får

x − y = c(x + y)3 .

Några av dessa banor visas i figuren nedan. Lösningen till systemet kan beräknas

exakt:

x(t) = c1 e−t + c2 e−3t ,

y(t) = c1 e−t − c2 e−3t .

Vi ser att då t → ∞, närmar sig x(t) den kritiska punkten O, hur vi än väljer

konstanterna c1 och c2 . Om så är fallet, eller om alla lösningsbanor närmar sig den

kritiska punkten då t → −∞, säger vi att den kritiska punkten är en nod.

7.2.2. Centra. Vi tar en titt på systemet

0

x = −x − y,

y 0 = 2x + y.

Också här är origo den enda kritiska punkten. Lösningsbanorna ges av

2x2 + 2xy + y 2 = C 2 ,

som är en familj av ellipser. Lösningen till systemet är

x(t) = −c1 (cos t + sin t) + c2 (cos t − sin t),

y(t) = 2c1 cos t + 2c2 sin t.

ANTECKNINGAR ODE

25

4

y

–4

2

–2

2

4

x

–2

–4

Figur 1. En nod

Banorna är slutna kurvor som kretsar runt den kritiska punkten O, utan att närma

sig denna då t → ∞ eller t → −∞ (med undantag av den konstanta lösningen

x(t) = y(t) = 0). En sådan kritisk punkt kallas för ett centrum.

7.2.3. Sadelpunkter. Låt systemet

x0 = x + 2y,

y 0 = 2x + y

vara givet. Också här är O den enda kritiska punkten, Lösningen är

x(t) = −c1 e−t + c2 e3t ,

y(t) = c1 e−t + c2 e3t .

Om c2 = 0, kommer lösningarna närma sig O då t → ∞ längs linjen y = −x. Om

c1 = 0 går lösningarna mot O då t → −∞ längs linjen y = x. Men om både c1 6= 0

och c2 6= 0, håller sig lösningarna borta från dessa två s.k. asymptoter. En kritisk

punkt kring vilken banorna beter sig på detta vis kallar vi sadelpunkt.

7.2.4. Spiraler. Vi betraktar nu systemet

p

0

x = −y −p

x x2 + y 2 ,

y 0 = x − y x2 + y 2 .

26

LEO LARSSON

2

y

–1

1

–0.5

0.5

1

x

–1

–2

Figur 2. Ett centrum

Återigen är O den enda kritiska punkten. Vi kan hitta banorna genom att införa

polära koordinater:

x = r cos θ,

y = r sin θ.

Vi får då

dx = cos θ dr − r sin θ dθ,

dy = sin θ dr + r cos θ dθ.

Ekvationen för banorna blir

sin θ dr + r cos θ dθ

cos θ − r sin θ

=

,

cos θ dr − r sin θ dθ

− sin θ − r cos θ

vilket förenklas till

dr

= −r2 .

dθ

Denna separabla ekvation har lösningen

1

r=

.

θ+c

Några av dessa banor visas i figuren. Banorna närmar sig den kritiska punkten,

men snurrar runt densamma oändligt många gånger. En sådan kritisk punkt kallas

spiral.

ANTECKNINGAR ODE

27

3

2

y

1

–3

–2

–1

1

2

3

x

–1

–2

–3

Figur 3. En sadelpunkt

7.3. Stabilitet. Vi definierar vad som menas med att en kritisk punkt till ett

autonomt system

0

x = F (x, y),

(23)

y 0 = G(x, y)

är (asymptotiskt) stabil.

Definition 7. Antag att P är en kritisk punkt till systemet (23). Vi säger att P

är stabil om det för varje R > 0 finns ett r ≤ R så att för varje lösningsbana x

till (23) sådan att |x(t0 ) − P | < r för något t0 gäller att |x(t) − P | < R för alla

t > t0 ; i annat fall sägs P vara instabil. Vi säger att P är asymptotiskt stabil om

P är stabil och om det finns ett r > 0 sådant att för varje lösningsbana x som

uppfyller |x(t0 ) − P | < r för något t0 gäller att

lim x(t) = P.

t→∞

• En nod/spiral är antingen instabil eller asymptotiskt stabil, beroende på

om banorna närmar sig noden då t → −∞ eller då t → ∞.

• Ett centrum är stabilt men inte asymptotiskt stabilt.

• En sadelpunkt är instabil.

28

LEO LARSSON

0.003

0.002

0.001

–0.004 –0.003 –0.002 –0.001

0.001

0.002

–0.001

–0.002

–0.003

Figur 4. En spiral

7.4. Linearisering. I många fall kan det autonoma systemet

0

x = F (x, y),

(24)

y 0 = G(x, y)

inte lösas exakt. Det kan därmed vara svårt att avgöra typen hos de kritiska

punkterna. Vi beskriver här en metod som i många fall duger till att bestämma

typen av en kritisk punkt till ett icke-linjärt system.

Antag att x0 = (x0 , y0 ) är en isolerad kritisk punkt till (24), d.v.s. att

F (x0 , y0 ) = 0 och G(x0 , y0 ) = 0

och att det inte finns några andra kritiska punkter alldeles i närheten av x0 . Om

funktionerna F och G Taylorutvecklas kring punkten x0 fås uttryck på formen

F (x, y) = a(x − x0 ) + b(y − y0 ) + H(x, y),

G(x, y) = c(x − x0 ) + d(y − y0 ) + K(x, y).

Om resttermerna H och K nu visar sig vara små då (x, y) befinner sig nära x0 ,

borde lösningarna till systemet (24) nära denna punkt bete sig likt lösningarna till

det linjära systemet

0

x = a(x − x0 ) + b(y − y0 ),

(25)

y 0 = c(x − x0 ) + d(y − y0 ),

den s.k. lineariseringen till (24). Detta är vad följande sats handlar om.

ANTECKNINGAR ODE

29

Sats 9. Antag att resttermerna H och K uppfyller

H(x, y)

K(x, y)

lim

= 0 och lim

= 0.

x→x0 |x − x0 |

x→x0 |x − x0 |

Antag, vidare, att egenvärdena λj till det linjära systemet (25) antingen är reella

och olika eller icke-reella med nollskild realdel. Då är x0 en kritisk punkt av samma

typ för systemet (24) som för (25).

Anledningen till att vi inte kan dra samma slutsats om egenvärdena är reella och lika eller rent imaginära är att dessa båda fall ligger på gränsen mellan

olika typer av kritiska punkter. Om man, i de fall som täcks av Sats 9, ”stör”

koefficientmatrisen något, så faller egenvärdena fortfarande inom samma kategori,

medan det i de undantagna fallen kan hända mer dramatiska saker. Antag t.ex.

att λ = ±3i. Då är den kritiska punkten ett centrum. Men om matrisen ändras

bara litegrann, skulle egenvärdena kunna bli a ± 3i, där a 6= 0. Helt plötsligt har

vi en nod, som antingen är stabil eller instabil, beroende på tecknet hos a. Det

icke-linjära systemet ligger i regel nära sin linearisering, men i gränsfallen kan det

inträffa att det linjära systemet fås genom att justera det icke-linjära systemet ”åt

fel håll”.

Exempel 28. Betrakta systemet

0

x = 5x(y − 1) + 6y,

(26)

y 0 = −7x + 8y(1 − 2xy).

Origo är en isolerad kritisk punkt. Här har vi

H(x, y) = 5xy

och K(x, y) = −16xy 2 .

Med polära koordinater fås

H(x, y) 5r2 cos θ sin θ =

|(x, y)| r

= 5r| cos θ sin θ| → 0,

r → 0,

och på liknande vis får vi

K(r cos θ, r sin θ)

= 0.

r→0

r

lim

Lineariseringen till (26) är

x0 = −5x + 6y,

y 0 = −7x + 8y,

och egenvärdena fås genom ekvationen

(−5 − λ)(8 − λ) + 42 = 0

eller

λ2 − 3λ + 2 = 0.

Lösningarna är λ = 1 och λ = 2, alltså två olika reella egenvärden. Enligt satsen

ovan är origo en kritisk punkt av samma typ till (26) som till lineariseringen – en

instabil nod.

Koefficientmatrisen för lineariseringen är i princip mycket enkel att beräkna.

Koefficienterna a, b, c och d är nämligen partiella derivator till funktionerna F

och G evaluerade i den kritiska punkten:

Fx (x0 , y0 ) Fy (x0 , y0 )

A=

.

Gx (x0 , y0 ) Gy (x0 , y0 )

30

LEO LARSSON

Exempel 29. Avgör typen hos den kritiska punkten (0, 0) till systemet

0

x = −3x cos y − sin y,

(27)

y 0 = 2x cos y − sin y.

Lösning. Vi verifierar för säkerhets skull att origo verkligen är en kritisk punkt.

Vi har

F (x, y) = −3x cos y − sin y

och

G(x, y) = 2x cos y − sin y,

så F (0, 0) = 0 och G(0, 0) = 0. Vidare gäller att

∂F

(0, 0) = −3,

∂x

∂G

(0, 0) = 2,

∂x

Egenvärdena uppfyller ekvationen

∂F

(0, 0) = −1,

∂y

∂G

(0, 0) = −1.

∂y

(−3 − λ)(−1 − λ) + 2 = 0

eller

λ = −2 ± i.

Eftersom funktionerna F och G antas vara väluppfostrade, har de väldefinierade,

konvergenta Taylorserier, så termerna av högre ordning uppfyller villkoren för Sats

9. Vi drar slutsatsen att origo är en asymptotiskt stabil spiral för systemet (27).

Exempel 30. Visa att (1, 1) är en instabil kritisk punkt till systemet

0

x = −7 + 8x + 2y − 3x2 ,

y 0 = 4 + 2x − 11y + 5y 2 .

Lösning. Om (x, y) = (1, 1) insättes i högerleden fås

−7 + 8 + 2 − 3 = 0

och

4 + 2 − 11 + 5 = 0,

så (1, 1) är en kritisk punkt. Koefficienterna för lineariseringen fås genom derivering

och instättning av (x, y) = (1, 1):

∂F

(1, 1) = 2,

∂x

∂G

(1, 1) = 2,

∂x

∂F

(1, 1) = 2,

∂y

∂G

(1, 1) = −1.

∂y

Vi löser ekvationen

(2 − λ)(−1 − λ) − 4 = 0,

eller

λ2 − λ − 6 = 0.

Lösningarna är

λ = 3 och λ = −1.

Reella egenvärden med olika tecken innebär en sadelpunkt, som är instabil.

ANTECKNINGAR ODE

31

8. Lyapunovs metod

Här beskrivs en metod som ibland är användbar för att visa (asymptotisk)

stabilitet hos en kritisk punkt. Vi säger först ett par ord om vad som menas med

att en funktion är (semi-)definit.

Definition 8. Antag att U ⊆ R2 innehåller origo, och att E : U → R uppfyller

E(0, 0) = 0.

Vi säger att E är positivt semi-definit om det dessutom gäller att

E(x, y) ≥ 0,

(x, y) ∈ U.

E kallas positivt definit om

E(x, y) > 0,

(x, y) ∈ U, (x, y) 6= (0, 0).

Negativt (semi-)definit definieras på samma sätt, fast men olikhetstecknen omvända.

Exempel 31. Funktionen

E1 (x, y) = x2

är positivt semi-definit, medan

E2 (x, y) = x2 + y 2

är positivt definit. Om m och n är positiva heltal och a, b > 0, är

E3 (x, y) = ax2m + by 2n

positivt definit, och

E4 (x, y) = −ax2m − by 2n

är negativt definit.

Vi antar här att (0, 0) är en kritisk punkt till det autonoma systemet

0

x = F (x, y),

(28)

y 0 = G(x, y).

Definition 9. Antag att E är positivt definit. Då är E en Lyapunov-funktion till

systemet (28) om dessutom

(a) Funktionen

∂E

∂E

F+

G

∂x

∂y

är negativt semi-definit eller

(b)

∂E

∂E

F+

G

∂x

∂y

är negativt definit.

Sats 10. Om systemet (28) har en Lyapunov-funktion, är origo en

(a) stabil

(b) asymptotiskt stabil

kritisk punkt.

32

LEO LARSSON

Detta kan troliggöras på följande sätt. Eftersom E är positivt definit, har E ett

lokalt minimum i origo. Antag att x(t) är en lösning till (28). Bilda funktionen

Ẽ(t) = E ◦ x(t).

Vi har då, enligt kedjeregeln

Ẽ 0 =

∂E

∂E

F+

G,

∂x

∂y

och denna funktion antas vara negativt (semi-)definit. Alltså är Ẽ avtagande (ickeväxande). Men Ẽ är E betraktad längs lösningsbanan x, så antagandena ger att E

avtar (inte växer) längs den riktade banan x. Det innebär att x rör sig i riktning

mot origo (inte rör sig bort från origo), eftersom E växer i alla riktningar från

origo.

För att illustrera hur detta kan fungera i praktiken ger vi följande exempel.

Exempel 32. Visa att (0, 0) är en asymptotiskt stabil kritisk punkt till systemet

0

x = xy − 3x3 ,

y 0 = −y − x6 .

Lösning. Vi söker en Lyapunov-funktion för systemet, och provar med en på formen

E(x, y) = ax2m + by 2n ,

där a, b > 0 och m och n är positiva heltal. Vi har

∂E

∂E

F+

G = 2max2m−1 (xy − 3x3 ) + 2nby 2n−1 (−y − x6 )

∂x

∂y

= 2max2m y − 6max2m+2 − 2nby 2n − 2nbx6 y 2n−1 .

Vi vill bestämma a, b, m och n så att detta blir negativt definit. De två mittersta

termerna gör ingen skada; däremot vore det bra om första och sista termerna tar

ut varandra, eftersom det i dessa förekommer udda potenser. Detta går att ordna

om vi ser till att 2m = 6, d.v.s. m = 3 och 1 = 2n − 1, d.v.s. n = 1. Vi vill alltså

ha

2 · 3ax6 y − 2 · 1bx6 y = 0,

vilket är sant om t.ex. a = 1 och b = 3. Vi får alltså den positivt definita funktionen

E(x, y) = x6 + 3y 2 ,

och detta ger

Ex F + Ey G = −18x8 − 6y 2 ,

som är negativt definit. Alltså är E en Lyapunov-funktion till systemet som uppfyller (b), så origo är en asymptotiskt stabil kritisk punkt.

♦

9. Variationskalkyl

I envariabelanalysen stöter vi ofta på problem av typen hitta minimum, om

det existerar, för den deriverbara funktionen f på intervallet (a, b). Vi löser detta

genom att studera punkter x sådana att f 0 (x) = 0. Funktionen f antar inte säkert

sitt minimum på det öppna intervallet (a, b); det kan finnas en entydig punkt

x0 där f antar sitt minimum; eller det kan finnas flera (t.o.m. oändligt många)

punkter i intervallet där f antar sitt minsta värde. Till minimeringsproblemet hör,

i synnerhet i flervariabelanalysen, ibland sidovillkor av olika typer.

ANTECKNINGAR ODE

33

Kortast avstånd: Antag att vi vill minimera en integral

Z 1p

1 + y 0 (x)2 dx,

0

med avseende på alla två gånger kontinuerligt deriverbara funktioner y

sådana att y(0) = 2 och y(1) = 5· Med andra ord vill vi hitta den funktion

vars graf ger det kortaste avståndet mellan punkterna (0, 2) och (1, 5).

Problemet kan formuleras sålunda.

Låt C vara mängden av kontinuerliga funktioner på [0, 1], som är två

gånger kontinuerligt deriverbara på (0, 1) och som är sådana att

y(0) = 2

och y(1) = 5.

För varje y i C, definiera

Z

I(y) =

1

p

1 + y 0 dx.

0

Hitta alla y i mängden C som ger I sitt minsta värde.

Kortast avstånd II: Antag, mer allmänt, att två punkter P1 och P2 på

en yta S är givna, och vi vill hitta den väg på ytan S som ger kortaste

avståndet mellan P1 och P2 . Antag att ytan S ges av ekvationen

G(x, y, z) = 0.

Problemet är då att hitta tre funktioner x, y och z på något intervall [t1 , t2 ]

sådana att

(x(tj ), y(tj ), z(tj )) = Pj , j = 1, 2,

G(x(t), y(t), z(t)) = 0, t ∈ [t1 , t2 ]

och sådana att integralen

s

Z t2 2 2 2

dx

dy

dz

+

+

dt

dt

dt

dt

t1

blir så liten som möjligt.

Maximal omsluten area: Antag att vi har en ögla av fixerad längd L,

med vilken vi vill omsluta en så stor area som möjligt. Hur ska vi definiera

funktionerna x(t) och y(t), 0 ≤ t ≤ 2π så att

Z 2π p

(x0 )2 + (y 0 )2 dt = L

0

och så att integralen

Z

1 2π

(xy 0 − yx0 ) dt

2 0

blir så stort som möjligt?

Hängande kedjan: Vilken form antar en kedja fäst i två punkter? Antag

att kedjan är fäst i punkterna (x1 , y1 ) och (x2 , y2 ), där vi antar att x1 < x2 .

Låt ρ vara (den konstanta) densiteten för kedjan. Låt x vara någon punkt

i intervallet (x1 , x2 ), och låt ∆x vara ett litet, positivt tal. Den potentiella

energin hos den del av kedjan vars x-koordinat ligger i intervallet (x, x+∆x)

är ungefär

gravitationskonstant × massa × höjd =

p

= g ρ (∆x)2 + (∆y)2 y(x),

34

LEO LARSSON

där ∆y betecknar skillnaden

y(x + ∆x) − y(x).

(29)

Kedjans totala potentiella energi är alltså, enligt principen ”summera och

låt ∆x → 0”

Z x2

p

E = gρ

y(x) 1 + (y 0 (x))2 dx.

x1

Eftersom kedjan (i vila) har lägsta möjliga energi, ges formen av grafen till

den funktion y som minimerar integralen i (29) och som uppfyller

y(xj ) = yj ,

j = 1, 2.

Gemensamt för dessa problem är att vi letar efter en funktion bland en given

klass av funktioner som ger en viss integral dess minsta värde. Grundproblemet,

utan bivillkor, kan allmänt formuleras på följande sätt.

Problem: Låt x1 < x2 och låt y1 och y2 vara reella tal. Antag att f (x, y, z)

har kontinuerliga partiella derivator av ordning två m.a.p. alla variabler.

Låt C vara mängden av två gånger kontinuerligt deriverbara funktioner y

som uppfyller randvillkoren y(x1 ) = y1 och y(x2 ) = y2 . Hitta de funktioner

i C som ger integralen

Z x2 dy

dx

f x, y,

dx

x1

sitt största/minsta värde.

Om vi definierar

Z

(30)

x2

I(y) =

f (x, y, y 0 ) dx

x1

för de y som anges ovan, gäller det alltså att hitta alla y0 som är sådana att

I(y0 ) ≤ I(y) eller I(y0 ) ≥ I(y) för alla y.

9.1. Eulers ekvation. Antag att y är en funktion i C som minimerar integralen

(30). Låt v vara någon två gånger kontinuerligt deriverbar funktion sådan att

v(x1 ) = v(x2 ) = 0.

Då är

w(x) = y(x) + tv(x)

en funktion i C för varje val av t. Om t 6= 0 och v inte är identiskt noll har vi

I(w) > I(y),

eftersom y är ett minimum. Vi fixerar funktionen v och betraktar funktionen

I(t) = I(y + tv)

av t. I ska alltså ha ett lokalt minimum för t = 0, eller

J 0 (0) = 0.

Eftersom

w0 (x) = y 0 (x) + tv 0 (x),

har vi att

Vi får

d

∂f

∂f 0

f (x, w, w0 ) =

v(x) +

v (x).

dt

∂w

∂w0

Z x2 ∂f

∂f 0

0

I (t) =

v(x) +

v (x) dx,

∂w

∂w0

x1

ANTECKNINGAR ODE

så för t = 0

x2

35

∂f 0

∂f

I (0) =

v(x) + 0 v (x) dx.

∂y

∂y

x1

Eftersom v(x1 ) = v(x2 ) = 0, fås genom partiell integration

Z x2

∂f 0

v (x) dx

0

x1 ∂y

x2 Z x2

d ∂f

∂f

v(x) dx

= 0 v(x) −

0

∂y

x1 dx ∂y

x1

Z x2

d ∂f

v(x) dx,

=−

0

x1 dx ∂y

så

Z x2 ∂f

d ∂f

0

I (0) =

−

v(x) dx.

∂y dx ∂y 0

x1

Om denna integral ska vara noll för alla v, måste vi ha

∂f

d ∂f

−

= 0.

(31)

0

dx ∂y

∂y

Denna differentialekvation kallas Eulers ekvation för problemet. Här ska partiella

derivatan m.a.p. y 0 tolkas som

∂f

,

∂z

där vi sätter in z = y 0 .

0

Z

9.2. Tillämpning av Eulers ekvation.

Exempel 33. Vi studerar problemet med kortaste avståndet mellan två givna punkter. Låt

√

f (x, y, z) = 1 + z 2

eller

p

f (x, y, y 0 ) = 1 + (y 0 )2 .

Vi har då

∂f

= 0,

∂y

så Eulers ekvation för detta f blir

d ∂f

= 0,

dx ∂y 0

eller

∂f

=C

∂y 0

y0

p

=C

1 + (y 0 )2

C2

(y 0 )2 = √

1 − C2

0

y =c

y = cx + d.

Konstanterna c och d bestäms sedan så att randvillkoren uppfylls. Kortaste avståndet mellan två givna punkter ges, inte oväntat, av en rät linje: y = 3x + 2.

♦

36

LEO LARSSON

Exempel 34. I problemet med hängande kedjan har vi

√

f (x, y, z) = gρy 1 + z 2 .

Notera att f här saknar direkt beroende av x. Vi får därför

d ∂f 0

df

d ∂f 0

y −f =

y −

0

0

dx ∂y

dx ∂y

dx

d ∂f

∂f

∂f 0 ∂f 00

=

y 0 + 0 y 00 −

y − 0y

0

dx ∂y

∂y

∂y

∂y

d ∂f

∂f

=

−

y 0 = 0.

dx ∂y 0

∂y

Eulers ekvation för detta problem får alltså formen

d ∂f 0

y −f =0

dx ∂y 0

eller

∂f 0

y − f = c.

∂y 0

Eftersom

yz

∂f

=√

,

∂z

1 + z2

får vi

p

y(y 0 )2

p

− y 1 + (y 0 )2 = c

1 + (y 0 )2

p

y(y 0 )2 − y(1 + (y 0 )2 ) = c 1 + (y 0 )2

y 2 = c2 (1 + (y 0 )2 )

dy

dx

p

=

c

y 2 − c2

Z

Z

dy

dx

p

=

+ d.

2

2

c

y −c

Sätt

y = c cosh t

i y-integralen, så att

dy = c sinh t dt

och

y 2 − c2 = c2 (cosh2 t − 1).

Vi får

Z

Z

dy

p

y2

−

c2

=

c sinh t

p

c cosh2 t − 1

Z

c sinh t

=

dt

c sinh t

=t

y

= cosh−1 .

c

Det följer att

cosh−1

y

x

= +d

c

c

dt

ANTECKNINGAR ODE

37

eller

x

+ c2 .

y = c1 cosh

c1

Konstanterna c1 och c2 bestäms sedan så att y uppfyller randvillkoren.

♦

×

×

Figur 5. Hängande kedjan

Exempel 35. Minimera

Z

I(y) =

2

(xy 0 − y)3 dx

1

bland de funktioner som uppfyller y(1) = y(2) = 1.

Lösning. Vi har här

f (x, y, z) = (xz − y)3 ,

så

∂f

= −3(xz − y)2

∂y

Det gäller vidare att

och

∂f

= 3x(xz − y)2 .

∂z

d

3x(xy 0 − y)2 = 3(xy 0 − y)2 + 6x(xy 0 − y)(y 0 + xy 00 − y 0 )

dx

= 3(xy 0 − y)(xy 0 − y + 2x2 y 00 ).

Eulers ekvation för problemet får utseendet

3(xy 0 − y)(xy 0 − y + 2x2 y 00 ) + 3(xy 0 − y)2 = 0

eller

(xy 0 − y)(x2 y 00 + xy 0 − y) = 0.

Vi har alltså antingen xy 0 − y = 0 eller 3x2 y 00 + xy 0 − y = 0. Den första av dessa

ekvationer är separabel, och har lösningarna

y = cx.

Ingen av dessa kan dock uppfylla randvillkoren, så vi koncentrerar oss på att lösa

den andra.

x2 y 00 + xy 0 − y = 0

38

LEO LARSSON

är en linjär, homogen ekvation av andra ordningen. Vi kan gissa oss till att en

lösning är

y(x) = x.

En andra lösning kan beräknas genom ansatsen

z = v · x,

där v är någon funktion (see avsnitt 3.2). Derivering och insättning ger

x3 v 00 + 3x2 v 0 = 0

eller

v 00

3

=− .

0

v

x

En lösning är

v=−

1

.

2x2

Vi får alltså

z=−

1

.

2x

Allmänna lösningen kan alltså skrivas

d

cx + .

x

Konstanterna c och d bestäms nu så att lösningen uppfyller de angivna randvillkoren. Vi får ekvationssystemet

c · 1 + d1 = 1,

c · 2 + d2 = 1

som har lösningen

1

2

Lösningen till problemet är således

c=

y=

2

och d = .

3

x

2

+ .

3 3x

♦

9.3. Fler än en obekant funktion. Eulers ekvation kan enkelt generaliseras till

flera funktioner. Om vi exempelvis önskar hitta ett minimerande par (x, y) av

funktioner till integralen

Z t2

f (t, x, y, x0 , y 0 ) dt,

t1

löser vi systemet

d ∂f

∂f

−

= 0,

dt ∂x0 ∂x

d ∂f

∂f

−

= 0,

0

dt ∂y

∂y

o.s.v. Detta kommer t.ex. till pass då vi vill lösa problemet med maximal omsluten

area. Först behöver vi dock introducera en annan variant.

ANTECKNINGAR ODE

39

9.4. Bivillkor med integraler. Som tillägg till kravet att

Z x2

I=

f (x, y, y 0 ) dx

x1

ska göras så liten som möjligt, kräver vi också att en annan integral

Z x2

J=

g(x, y, y 0 ) dx

x1

har ett förutbestämt värde c.

Inspirerade av Lagranges multiplikatormetod, sätter vi

F (x, y, z, λ) = f (x, y, z) + λg(x, y, z).

Ett resonemang likt det i avsnitt 9.1, tillämpat på F (x, y, y 0 , λ), ger att y måste

uppfylla differentialekvationen

∂F

d ∂F

−

= 0.

0

dx ∂y

∂y

Notera dock att allmänna lösningen till denna i allmänhet omfattar tre konstanter – två integrationskonstanter och multiplikatorn λ. Integrationskonstanterna

bestäms som vanligt genom randvillkoren, medan λ anpassas så att integralvillkoret J = c uppfylls.

Exempel 36. Detta är en variant på problemet med maximal omsluten area. Antag

att vi har ett snöre av längd π/2, som vi fäster i punkterna (0, 0) och (1, 0). Vi

vill bestämma den form på snöret som tillsammans med x-axeln omsluter största

möjliga area. Vi vill alltså maximera integralen

Z 1

y dx

0

under bivillkoret

1

Z

p

1 + (y 0 )2 dx =

0

π

2

bland de funktioner som uppfyller

y(0) = y(1) = 0.

Vi antar dessutom att y(x) > 0 då 0 < x < 1. Sätt

√

F (x, y, z, λ) = y + λ 1 + z 2 .

Det gäller då att

∂F

=1

∂y

och

Eulers ekvation blir

∂F

λz

.

=√

∂z

1 + z2

d

λy 0

p

= 1,

dx 1 + (y 0 )2

som kan integreras till

λy 0

p

1 + (y 0 )2

Detta skrivs om till

= x + c.

x+c

y0 = p

λ2 − (x + c)2

.

40

LEO LARSSON

Exempelvis genom substitutionen x + c = λ sin t kan

få

p

y + d = λ2 − (x + c)2

eller

(x + c)2 + (y + d)2 = λ2 .

Konstanterna kan beräknas till

1

c = − , d = 0 och λ =

2

Snöret ska alltså ligga längs cirkeln

2

1

1

+ y2 = .

x−

2

4

vi integrera ekvationen och

1

.

2

♦